Os clientes descrevem cada vez mais a mesma experiência:

Os clientes descrevem cada vez mais a mesma experiência:

"Senti-me ouvido, mas não ajudado."

Uma conversa agradável, seguida de zero resolução.

Isto tem um nome:

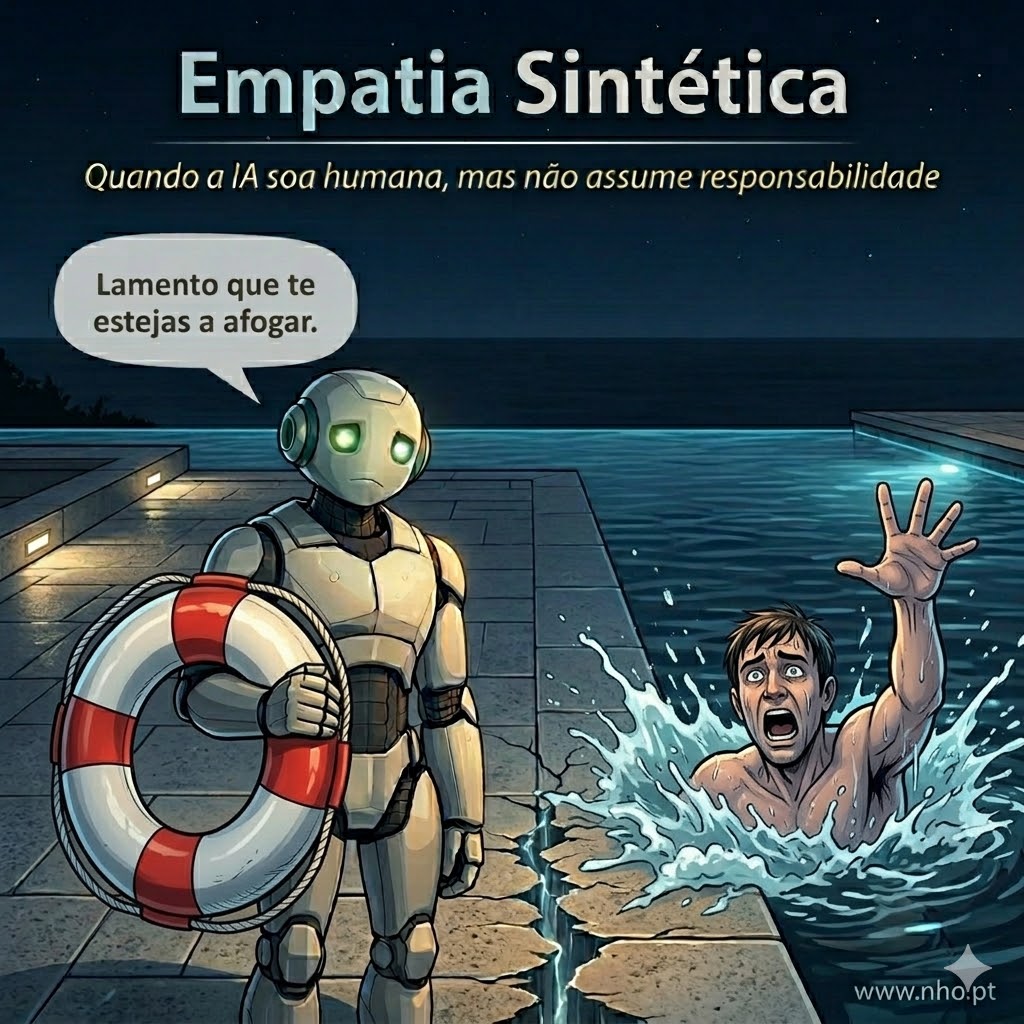

Empatia Sintética!Há uns meses, consultei o suporte de um serviço que uso há anos. O chatbot foi impecável. Tom caloroso. Frases validadoras. "Compreendo a sua frustração." "É completamente natural sentir-se assim." Parecia quase humano.

Depois de 8 minutos de conversa empática, o resultado: nenhum. Transferência para um formulário. Resposta em 48 horas. O robô fez-me sentir ouvido — e depois abandonou-me.

É isto que está a acontecer à escala em milhares de empresas. E é um problema sério que a maioria dos gestores nem sequer vê nos dashboards.

Empatia sem acção é manipulação educada

Vamos ser diretos: quando um sistema reconhece a tua emoção mas não tem autoridade para resolver o teu problema, não está a ser empático. Está-te a gerir.

A diferença entre empatia e compaixão é simples mas crucial. Empatia é perceber o que o outro sente — "entendo o que estás a passar." Compaixão é fazer algo com isso — "vou resolver isto." A IA actual domina a primeira parte. Detecta sentimentos com precisão impressionante. Adapta o tom. Valida frustrações. Espelha preocupação.

Mas não sente tensão quando há trade-offs difíceis. Não assume consequências quando a decisão é errada. Não perde o sono.

Empatia sem responsabilidade não é empatia. É teatro.

Onde é que isto colapsa: nos momentos que mais importam

E aqui está a ironia. As empresas estão a colocar IA "empática" exatamente nos momentos mais sensíveis do percurso do cliente: reclamações, atrasos, problemas de faturação, falhas de serviço.

São os momentos em que o cliente precisa de alguém com poder de decisão. E recebe um robô que diz "compreendo" mas não pode fazer nada.

O resultado? As métricas de satisfação imediata até sobem — a interação foi "agradável". Mas a confiança a longo prazo corroí-se silenciosamente. O cliente sente calor, mas vazio. É como ir a um médico que te ouve com atenção durante 20 minutos e depois te manda embora sem diagnóstico.

Os inquéritos de satisfação não apanham isto. Mas a taxa de retenção apanha.

O erro: tratar empatia como um problema de linguagem

Muitas implementações de experiência de cliente reduzem a empatia ao tom de voz, microcopy, ou prompts bem desenhados. Como se o problema fosse linguístico.

Não é. Daniel Goleman descreve a empatia como parte da inteligência social: a capacidade de compreender os outros e navegar as implicações morais e relacionais dessa compreensão. Não é uma questão de palavras — é uma questão de acção.

Vejo isto frequentemente em PMEs portuguesas que investiram em automação sem pensar no desenho do processo por trás. Montaram o chatbot, configuraram as respostas automáticas, e agora têm um sistema que fala bonito mas não decide nada.

O cliente entra num loop: bot empático → formulário → espera → email genérico → frustração.

A automação acelerou o contacto. Mas não acelerou a resolução.

A pergunta certa não é "quão humana a IA consegue soar?"

A pergunta certa é: onde é que a responsabilidade exige presença humana?

Isto muda completamente a forma como desenhas o teu sistema. Em vez de automatizares tudo e pores um humano "se necessário", começas pelo inverso: identificas onde a decisão, a ambiguidade ou o peso emocional exigem uma pessoa real — e automatizas o resto.

Há uma matriz simples que ajuda a decidir:

- Carga emocional baixa + contexto claro + consequências reversíveis → a IA resolve bem e deve resolver. Consultas de estado de encomenda, FAQs, agendamentos simples.

- Carga emocional alta + contexto ambíguo + consequências irreversíveis → precisa de um humano. Reclamações complexas, cancelamentos, situações de crise.

O problema é que a maioria das empresas não faz esta distinção. Automatiza tudo por igual e depois surpreende-se quando os clientes desaparecem em silêncio.

O que isto significa na prática para o teu negócio

Se geres uma PME B2B em Portugal e estás a pensar em meter IA no teu serviço ao cliente, aqui fica o que aprendi:

Primeiro, mapeia antes de automatizar. Pega no percurso do teu cliente e marca os momentos de alta tensão emocional. São esses que precisam de gente real — não de bots com boas maneiras.

Segundo, dá poder de decisão a quem fala com o cliente. De nada serve ter um humano em linha se ele precisa de pedir autorização a três níveis para resolver um problema de €20. Empatia real exige autonomia real.

Terceiro, mede a retenção, não só a satisfação. Um NPS de 8 numa interação com um bot não significa nada se o cliente não volta. O número que interessa é: quantos clientes ficaram? Quantos voltaram a comprar? Quantos te recomendaram?

Quarto, liga tudo. Se o teu sistema de suporte não fala com o CRM, que não fala com o histórico de compras, que não fala com o marketing — o teu humano chega à conversa tão cego como o bot. O contexto tem de estar à mão, automaticamente, antes da conversa começar.

A empatia não é uma funcionalidade. É consciência. A compaixão é uma promessa — implica responsabilidade, acção e consequências. A IA escala a eficiência. Os humanos dão significado. O futuro da experiência do cliente não é fazer a IA soar mais humana. É saber, com clareza, onde parar a automação e deixar entrar quem pode realmente resolver.

Os clientes descrevem cada vez mais a mesma experiência:

Os clientes descrevem cada vez mais a mesma experiência: